如果說手機和相機的拍照差距在哪方面最明顯,那應該要數淺景深的拍攝效果了。淺景深的效果,即我們常說的背景虛化效果就沒有那麼簡單了,淺景深效果主要依賴大光圈以及大尺寸感光元件,這兩者和體積小巧手機本身就是矛盾關係,因此依舊需要依靠演算法來實現。

目前手機實現淺景深效果的方法依舊是利用摳像演算法,將拍攝對焦主體獨立出來,再將其他區域進行虛化模擬處理,得到一張類似光學淺景深效果的照片。因此這裡最為關鍵的技術就是摳像,在人像拍攝場景,最難「摳」的,就是頭髮區域,由於幾乎沒有規律且髮絲極細,很多手機的演算法都會在此區域露餡。針對這些場景,一向以演算法見長的Google在近日釋出了一套針對自家Pixel 6系列手機的解決方案。

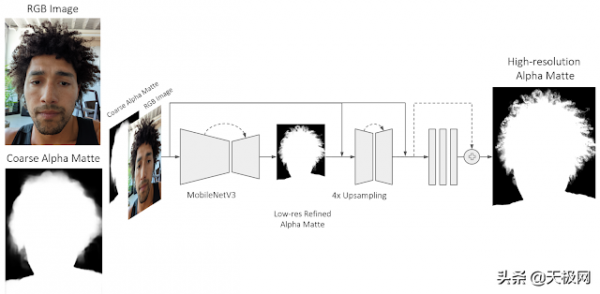

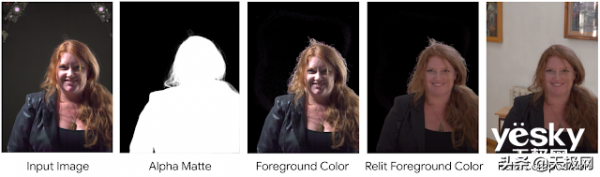

根據Google AI Blog介紹,這套新的人像模式解決方案利用的是Alpha Matting技術,該技術此前多用於電影製作領域,用於精確的摳像以及背景替換。Google將RGB原照片以及Alpha遮罩低解析度摳像輸入神經網路,利用MobileNetV3預測更高解析度、更加精確的遮罩,從而幫助主體從背景分離。

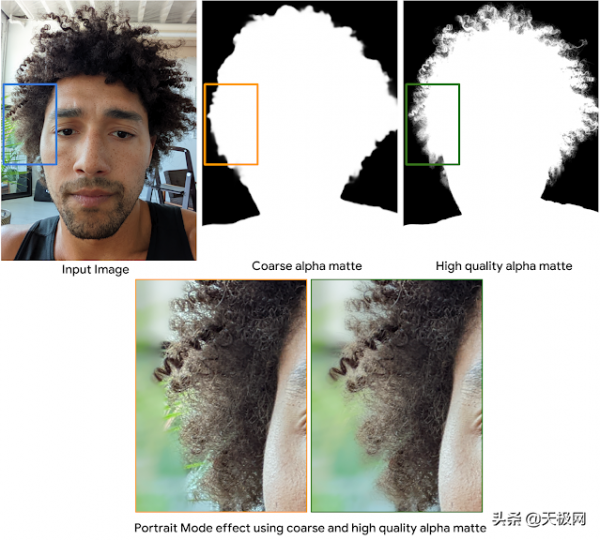

從部落格公佈的效果對比圖來看,這套演算法的摳像提升還是立竿見影的。樣本模特的髮型對於目前任意手機來說都是「地獄級」難度,Google能夠將捲髮的邊緣髮絲精細地勾勒出來,這樣的效果在此之前確實從未見過。透過區域性放大的對比圖可以看到,由於摳圖更加精細,因此髮絲邊緣的景深過度也相當精準,做到幾乎以假亂真的效果。

此外,為了使摳像主體的光線與背景相匹配,Google還使用了一種球形的裝置進行樣本採集,該裝置配備331個自定義彩色LED燈,一系列高解析度攝像頭和一組自定義高解析度深度感測器。利用多種角度的打光以及攝像頭的拍攝來模擬不同光線下,人像應當有怎樣的光線效果。

針對這項改進,Google也做了演示。演示中,Google將輸入的影象經過一系列的處理,並重新合成到新背景中,整體臉部的光照條件與背景也是較為符合的,相對於原圖,其光線在背景中並不會顯得特別的突兀。

值得一提的是,今年的Pixel 6手機是Google有史以來相機硬體最為強大的一代,在此之前,Google一直沿用相當老舊的CMOS進行演算法最佳化,其實際的成像效果雖然依舊出色,但仍然難以比肩最新的頂級拍照旗艦。也許也是意識到了硬體上的鴻溝難以跨域,Google在Pixel 6上使用了大底主攝,以求提升整體的拍攝能力。但實際的市場反饋似乎並沒有能夠與外界的期待相匹配,這似乎又是計算攝影重要性的一個有力佐證。

手機的硬體雖然重要,但在自動模式下,演算法仍然是使用者能夠得到的優質拍攝效果的最有力的依靠。此前有訊息稱Google手機計算攝影團隊有關鍵成員離職,而這套全新的人像演算法顯然給了Google手機使用者一個信心,不過目前我們收集到的內容也僅有Google官方的測試,具體的效果仍然需要等Pixel 6系列實裝之後,經由外界測試來進行評判好與壞。