近日,由國際音訊頂級會議ICASSP(International Conference on Acoustics, Speech, and Signal Processing,國際音訊、語音與訊號處理會議)聯合阿里巴巴發起的ICASSP 2022多通道多方會議轉錄挑戰賽(M2MeT)落下帷幕,喜馬拉雅智慧語音實驗室和中國科學技術大學合作,在說話人日誌賽道獲得第三名。同時,相關論文已經被ICASSP 2022收錄,並受邀於今年5月份在新加坡舉辦的線上/線下會議中進行展示,這是今年喜馬拉雅的第二項研究技術成果得到ICASSP 2022的認可。

此前,喜馬拉雅自研的跨語言語音合成創新技術論文有關跨語言語音合成創新技術的論文已被ICASSP 2022錄用。ICASSP是由IEEE(電氣電子工程師學會)主辦的在訊號處理及其應用方面的頂級會議,在國際上享有盛譽並具有廣泛的學術影響力。今年是ICASSP的第47屆會議,會議主題為“以人為本的訊號處理”。

而M2MeT挑戰賽是ICASSP2022訊號處理大挑戰(Grand Challenge)之一,包括說話人日誌和多說話人語音識別兩個賽道,旨在進一步促進該領域的深入研究。喜馬拉雅和中國科學技術大學合作在說話人日誌賽道取得了4.05% 的日誌錯誤率(DER)結果,名列第三位。 第一、第二名分別由崑山杜克大學的李明教授團隊(2.98%)和騰訊-香港中文大學團隊(3.98%)獲得。

說話人日誌技術,也稱說話人分段聚類,透過記錄多說話人音訊資料上屬於特定說話人的語音事件來解決“誰在什麼時候說話”的問題,比如在語音聊天室場景中,可以告訴開會者當前誰在說話。同時,該技術也在其他相關的語音處理技術中扮演著重要角色,比如會議轉寫的語音識別,或者為語音分離、VAD等其他語音技術提供關鍵的先驗資訊。

會議場景是語音技術應用中最有價值、同時也是最具挑戰性的場景之一。因為這樣的場景包含了豐富的講話風格和複雜的聲學條件,需要考慮到重疊語音、數量未知的說話人、大型會議室中的遠場訊號、噪音和混響等挑戰。而此次的M2MeT挑戰賽便聚焦中文會議資料,對參賽團隊提出了挑戰。

為了提高日誌準確率,喜馬拉雅和中國科學技術大學合作研發的系統,在語音的預處理上,首先使用麥克陣列技術對訊號進行降噪、降混響,使得訊號相對純淨,之後使用基於深度學習的聲紋模型和譜聚類方法,對多人遠場資料進行初步處理,並使用多通道標籤融合技術對不同通道的結果進行融合,進一步提升準確率。

由於在挑戰賽的會議場景中,多人同時說話的比例達到30~40%,傳統聚類方法在該場景下會產生極高的漏判錯誤(MISS ERROR),因此喜馬拉雅創新研發的系統還使用target-speaker VAD將聚類問題轉化為多標籤問題處理,並使用神經網路進行建模和訓練。在採用多種資料增強和後處理策略後,成功將DER由基線的15.6%降低到4.05%,基本達到了實用要求。

喜馬拉雅已在AI語音技術領域潛心鑽研多年,並在內部專門成立了喜馬拉雅智慧語音實驗室這一核心部門,長期專注於語音合成、識別、語音訊號處理、編解碼以及智慧音效的研究和開發,而這次說話人日誌技術的研究成果便來自於這一部門。目前,喜馬拉雅已經在研發類似會議場景的多人同時會議轉寫專案,其中說話人日誌解決了誰在什麼時候說話的問題,大幅度提升了撰寫效果。未來,喜馬拉雅的說話人日誌技術,也將可能被應用到更多場景中,比如語音聊天室,告訴參與者當前誰在說話;又比如喜馬拉雅的AI文稿,說話人日誌技術透過提供說話人的資訊,有利於進一步提高AI文稿的準確率。

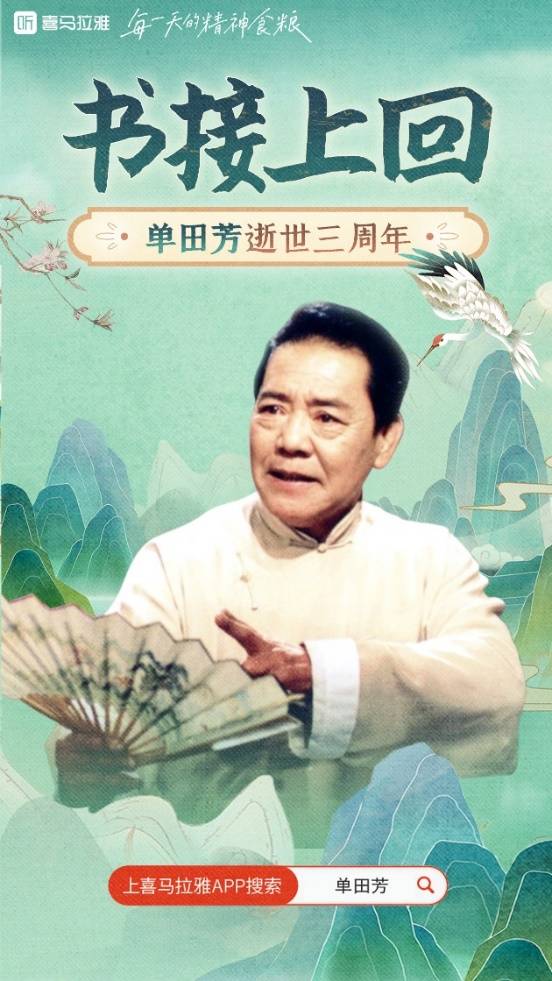

除了說話人日誌,喜馬拉雅的TTS(語音合成)技術也處於行業前列,並已經廣泛被運用於評書、新聞、小說等多種內容的製作中,正助力喜馬拉雅在現有的“UGC + PGC + PUGC”內容生態之外,進一步拓展AIGC的可能性。

2021年,喜馬拉雅透過將自主設計單獨的韻律提取模組融入到 HiTTS 技術框架,完美復現了單田芳的“聲音”,目前已用單田芳的AI合成音上線了超過80張的“單田芳聲音重現”專輯,其中,《毛氏三兄弟》和歷史類作品的聲音完播率遠超過普通人聲作品,為未來出版物大量有聲化提供了新的解決方案。此前喜馬拉雅被ICASSP 2022S收錄的自研跨語言語音合成技術,未來將可能讓我們聽到單田芳先生的“聲音”來播講英文內容。同時,2021年,還有新京報、環球時報、瀟湘晨報、時代週報、海外網、刺蝟公社等眾多主流媒體入駐喜馬拉雅,藉助喜馬拉雅TTS技術加速製作新聞類音訊節目,讓聽眾有了更多的渠道聽到更權威的新聞。

未來,喜馬拉雅將持續投入語音技術的研發升級,不斷創新和突破,進一步開啟對於聲音的想象,讓技術加持聲音、讓聲音服務生活。